1.R是用于统计分析和图形化的计算机语言及分析工具;

2.Weka可能是名气最大的开源机器学习和数据挖掘软件,但用起来并不方便,界面也简单了点;

3.Tanagra 是使用图形界面的数据挖掘软件;

4.RapidMiner现在流行的势头在上升,但它的操作方式和商用软件差别较大,不支持分析流程图的方式,当包含的运算符比较多的时候就不容易查看了;

5.KNIME和Orange看起来都不错,Orange界面看上去很清爽,但我发现它不支持中 文。推荐KNIME,同时安装Weka和R扩展包。

对于普通用户可以选 用界面友好易于使用的软件,对于希望从事算法开发的用户则可以根据软件开发工具不同(Java、R、C++、Python等)来选择相应的软件。

常用的数据挖掘工具有哪些

1、 Weka

WEKA作为一个公开的数据挖掘工作平台,集合了大量能承担数据挖掘任务的机器学习算法,包括对数据进行预处理,分类,回归、聚类、关联规则以及在新的交互式界面上的可视化。

2、 Rapid Miner

RapidMiner是世界领先的数据挖掘解决方案,在一个非常大的程度上有着先进技术。它数据挖掘任务涉及范围广泛,包括各种数据艺术,能简化数据挖掘过程的设计和评价。

3、 Orange

Orange是一个基于组件的数据挖掘和机器学习软件套装,它的功能即友好,又很强大,快速而又多功能的可视化编程前端,以便浏览数据分析和可视化,基绑定了 Python以进行脚本开发。它包含了完整的一系列的组件以进行数据预处理,并提供了数据帐目,过渡,建模,模式评估和勘探的功能。其由C++ 和 Python开发,它的图形库是由跨平台的Qt框架开发。

4、 Knime

KNIME (Konstanz Information Miner) 是一个用户友好,智能的,并有丰演的开源的数据集成,数据处理,数据分析和数据勘探平台。

5、 jHepWork

jHepWork是一套功能完整的面向对象科学数据分析框架。 Jython宏是用来展示一维和二维直方图的数据。该程序包括许多工具,可以用来和二维三维的科学图形进行互动。

6、 Apache Mahout

Apache Mahout 是 Apache Software Foundation (ASF) 开发的一个全新的开源项目,其主要目标是创建一些可伸缩的机器学习算法,供开发人员在 Apache 在许可下免费使用。该项目已经发展到了它的最二个年头,目前只有一个公共发行版。Mahout 包含许多实现,包括集群、分类、CP 和进化程序。此外,通过使用 Apachehadoop库,Mahout 可以有效地扩展到云中。

7、 ELKI

ELKI(Environment for Developing KDD-Applications Supported by Index-Structures)主要用来聚类和找离群点。ELKI是类似于weka的数据挖掘平台,用java编写,有GUI图形界面。可以用来寻找离群点。

8、 Rattle

Rattle(易于学习的 R 分析工具)提供数据的统计和可视化摘要,将数据转换成容易建模的形式,从数据中构建无监督和监督模型,以图形方式呈现模型的性能,并得出新的数据集。

数据挖掘的应用领域有哪些

金融、医疗保健、市场业、零售业、制造业、司法、工程和科学、保险业。

介绍:

数据挖掘,又译为资料探勘、数据采矿。它是数据库知识发现中的一个步骤。数据挖掘一般是指从大量的数据中自动搜索隐藏于其中的有着特殊关系性的信息的过程。数据挖掘通常与计算机科学有关,并通过统计、在线分析处理、情报检索、机器学习、专家系统和模式识别等诸多方法来实现上述目标。

发展历程:

需要是发明之母。近年来,数据挖掘引起了信息产业界的极大关注,其主要原因是存在大量数据,可以广泛使用,并且迫切需要将这些数据转换成有用的信息和知识。获取的信息和知识可以广泛用于各种应用,包括商务管理,生产控制,市场分析,工程设计和科学探索等。

大数据挖掘通常用哪些软件

1.RapidMiner

只要是从事开源数据挖掘相关的业内人士都知道,RapidMiner在数据挖掘工具榜上虎踞榜首,叫好叫座。是什么让RapidMiner得到如此厚誉呢?首先,RapidMiner功能强大,它除了提供优秀的数据挖掘功能,还提供如数据预处理和可视化、预测分析和统计建模、评估和部署等功能。更厉害的是,它还提供来自WEKA(一种智能分析环境)和R脚本的学习方案、模型和算法,让它成为业界的一棵常春藤。

用Java语言编写的RapidMiner,是通过基于模板的框架为用户提供先进的分析技术的。它最大的好处就是,作为一个服务提供给用户,而不是一款本地软件,用户无需编写任何代码,为用户尤其是精于数据分析但不太懂编程的用户带来了极大的方便。

2.R-Programming

R语言被广泛应用于数据挖掘、开发统计软件以及数据分析中。你以为大名鼎鼎的R只有数据相关功能吗?其实,它还提供统计和制图技术,包括线性和非线性建模,经典的统计测试,时间序列分析、分类、收集等等。

R,R-programming的简称,统称R。作为一款针对编程语言和软件环境进行统计计算和制图的免费软件,它主要是由C语言和FORTRAN语言编写的,并且很多模块都是由R编写的,这是R一个很大的特性。而且,由于出色的易用性和可扩展性,也让R的知名度在近年来大大提高了,它也逐渐成为数据人常用的工具之一。

3.WEKA

WEKA支持多种标准数据挖掘任务,包括数据预处理、收集、分类、回归分析、可视化和特征选取,由于功能多样,让它能够被广泛使用于很多不同的应用——包括数据分析以及预测建模的可视化和算法当中。它在GNU通用公共许可证下是免费的,这也是它与RapidMiner相比的优势所在,因此,用户可以按照自己的喜好选择自定义,让工具更为个性化,更贴合用户的使用习惯与独特需求。

很多人都不知道,WEKA诞生于农业领域数据分析,它的原生的非Java版本也因此被开发了出来。现在的WEKA是基于Java版本的,比较复杂。令人欣喜的是,当它日后添加了序列建模之后,将会变得更加强大,虽然目前并不包括在内。但相信随着时间的推移,WEKA一定会交出一张很好看的成绩单。

4.Orange

对很多数据人来说,Orange并不是一个陌生的名字,它不仅有机器学习的组件,还附加有生物信息和文本挖掘,可以说是充满了数据分析的各种功能。而且,Orange的可视化编程和Python脚本如行云流水,定能让你拥有畅快的使用感。

Orange是一个基于Python语言的功能强大的开源工具,如果你碰巧是一个Python开发者,当需要找一个开源数据挖掘工具时,Orange必定是你的首选,当之无愧。无论是对于初学者还是专家级大神来说,这款与Python一样简单易学又功能强大的工具,都十分容易上手。

5.NLTK

著名的开源数据挖掘工具——NLTK,提供了一个语言处理工具,包括数据挖掘、机器学习、数据抓取、情感分析等各种语言处理任务,因此,在语言处理任务领域中,它一直处于不败之地。

想要感受这款深受数据人喜爱的工具的用户,只需要安装NLTK,然后将一个包拖拽到最喜爱的任务中,就可以继续葛优瘫N日游了,高智能性也是这款工具受人喜爱的最大原因之一。另外,它是用Python语言编写的,用户可以直接在上面建立应用,还可以自定义小任务,十分便捷。

6.KNIME

KNIME是一个开源的数据分析、报告和综合平台,同时还通过其模块化数据的流水型概念,集成了各种机器学习的组件和数据挖掘。我们都知道,提取、转换和加载是数据处理最主要的三个部分,而这三个部分,KNIME均能出色地完成。同时,KNIME还为用户提供了一个图形化的界面,以便用户对数据节点进行进一步的处理,十分贴心。

基于Eclipse,用Java编写的KNIME拥有易于扩展和补充插件特性,还有可随时添加的附加功能。值得一提的是,它的大量的数据集成模块已包含在核心版本中。良好的性能,更让KNIME引起了商业智能和财务数据分析的注意。

数据挖掘和软件架构?大家觉得哪个更有前景?

对那个更有兴趣咯,数据挖掘考虑的是模型的性能,而架构考虑的是整个软件的性能和开发。

学习数据挖掘一般要学哪些软件和工具

1.数据挖掘基本知识

这一部分主要是看书,先了解一个情况。至于用什么书。口碑比较好的有《数据挖掘:概念与技术(第3版)》。我买了,看了一大半,感觉不太适合初学者。有些概念直接给出,对于底子不好的人有些突兀,要是硬着头皮使劲看,还是很有收获的,适合入门以后反复看。推荐一本很老的书《数据仓库与数据挖掘》。这本书相对来说不那么厚,很多基础概念也有论述,对初学者来说很友好。

这一部分的学习是贯穿始终的,有经验的前辈们介绍,什么时候拿出来看看都是有收获的。

2.数学基础

这一部分也是不可或缺的,学一下未必能有感受。学好了,绝对收益无穷。我的计划是穿插在整个学习过程中。主要内容是:线性代数、离散数学。

(1)线性代数

已经学过的,没学过的都要认真学一下。国内的教材个人以为对概念没有深入说透。比如特征值和特征向量,到底干嘛用的。矩阵的乘法本质意义,也没说清楚。

(2)离散数学

这个大部分人(不是专业的)都没学过,听着就头痛。别急,不用全学,重点是图论、代数系统、命题(谓词和逻辑)、集合与关系。随便找一本薄一点的教材。这些内容其实之前高中本科都有接触,主要是一些逻辑符号,思维方式需要看懂。否则在一些地方看到一些莫名其妙的符号,不了解,看到一些简单的公式以为很复杂,得不偿失。

(3)运筹学

这个绝对是基础课,之所以放在后面是因为本人认真学了。推荐的教材《运筹学》教材编写组编写。一本大厚绿皮书。对策论等跟博弈论有关的不用看。有条件的可以把算法在跑一遍。绝对收获良多。

3.工具

这部分本人在网上查了很久,课题组问了几百遍。最终确认的这几个。很多人说有编程经验的人,学一个就一两周的事,无奈,我零基础。所以,这一部分绝对是个重点。先说本人确定的语言:MATLAB、Python、R。

(1)MATLAB

先说MATLAB,别说这个老,别说这个是学校搞学术才用的。不想挑起争论,主要理由——好上手。上手以后就可以跑一些算法,提高一些信心和学习的乐趣。教材我随便找一本厚厚的备查(从来没翻过)。我主要看的是官方手册的Primer。然后就开始写脚本和函数,如果有看不懂的直接百度、google或者help。写的都很清楚。这一部分主要是迅速上手,我已经略有收获了。

(2)Python和R

这两个放在一起,是因为网上关于这两个的争论太多了。本人也无数次迷失过。不争论优劣,确实是各有优势。我的顺序是首先学python,立志以这个作为自己的主要程序。其次再是R,从画图入手。R画出来的图真是好看。至于学习的思路:先找一本入门的书,越简单越好,学完之后找一本手册,然后练习。

首先python,先看《Head First Python》。挺好的。简单易懂,网上竟然还能下载到英文的PDF。然后是《利用Python进行数据分析》和《机器学习实战》。第一本书主要是利用Python做数据挖掘的,基本提到Python学习都会推荐这本。第二本是理解机器学习的佳作,书中用到的语言就是Python。一边学语言,一边理解机器学习。很好的顺序。

其次R,因为有了前面的一部分基础,学起来会容易一些。主要推荐教材是《R语言初学者指南》和《R语言实战》。这部分的学习我准备跳着看,早期主要利用R来画图。然后步步深入着学习。这样才能充分的练习,而不仅仅是纸上谈兵。

(3)Mysql

最后加一个,了解一点Mysql,由于零基础对数据的各种都不了解,强烈推荐一周读完《深入浅出Mysql》。难度不大,主要是入门。如果以后用得着,再深入研究。

再次重申一遍:这一阶段还是要找程序写。如果有工作或者项目,直接上,学的最快。如果没有,找篇不错的,感兴趣的博士论文,跑一遍里边的程序。这部分内容不是学出来的,绝对练出来的。

4.算法

算法太多了,常见的就那些。一方面要看明白,理解算法。另一方面用上面的语言跑出来。既能理解算法,也能很好的熟悉语言。

总结

整个入门阶段,千万不要抱着学完一个在学一个的思想。同时学!比如,语言入门了,就找算法实践。看到一个算法,一定要程序跑出来。中间累了,把数学基础补一补。

目前主流的数据挖掘软件有哪些?哪些比较好?哪些适合大型企业?哪些适合中小型企业?

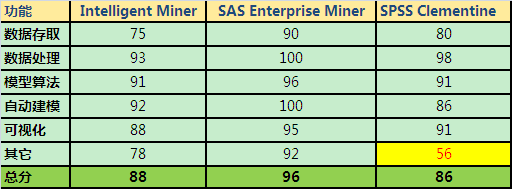

IntelligentMiner:简单易用,是理解数据挖掘的好的开始。能处理大数据量的挖掘,功能一般。没有数据探索功能,与其他软件接口差,难以发布,结果美观,但不易理解。

SASEnterpriseMiner:SAS完全以统计理论为基础,功能强大,有完备的数据探索功能。但难以掌握,要求高级统计分析专业人员,结果难以理解。价格极其昂贵。

SPSSClementine:一个开放式数据挖掘工具、资料探勘工具。不但支持整个数据挖掘流程,还支持数据挖掘的行业标准--CRISP-DM。相对于SAS易于掌握,要求有一定的统计分析基础。缺点无中文支持。

这个是平分,其中spss其它很低时因为缺少中文支持!!

中小型企业选择spss就可以了,界面友好,比较容易上手!

常用的数据挖掘工具有哪些?

有很多啊,SAS,SPSS climentine,wake,R,statistica,等统计软件都可以的。

转载请注明出处51数据库 » 数据挖掘软件都有哪些 数据挖掘用什么软件

丶妖冶叔叔

丶妖冶叔叔