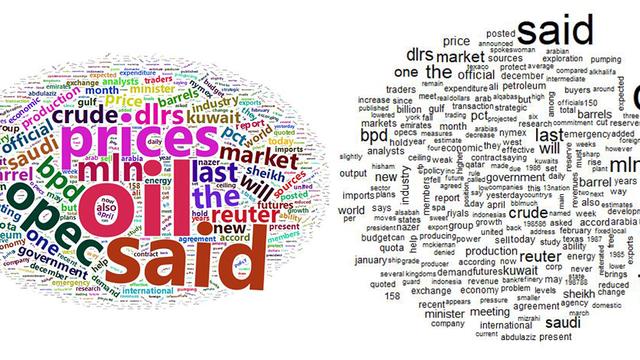

如何用Python做词云

推荐使用jieba模块来实现分词,WordCloud来绘制词云。

# -*- coding: utf-8 -*-

from PIL import Image

import numpy as np

import matplotlib.pyplot as plt

import jieba

from wordcloud import WordCloud, STOPWORDS

# Read the whole text.

text = open('内容.txt', 'r').read()

text = " ".join(jieba.cut(text, cut_all=False))

# 爱心.png表示你绘图模板,就是最后图片的形状

alice_mask = np.array(Image.open('爱心.png'))

# 中文需要设置字体,songti.ttf代表宋体

wc = WordCloud(font_path='songti.ttf', background_color="white", mask=alice_mask,

max_words=2000)

# generate word cloud

wc.generate(text)

# store to file

wc.to_file('result.png')

# show

plt.imshow(wc)

plt.axis("off")

# plt.figure()

# plt.imshow(alice_mask, cmap=plt.cm.gray)

# plt.axis("off")

plt.show()

如何让r语言的词云图变得好看些

Ian Fellows与2014-06-13公布了wordcloud包,之前我用wordcloud包写了一篇关于文本可视化的博客。这里就不再多说了。就在今年2016-07-25,Dawei Lang发布了wordcloud2,它是wordcloud的一个升级版。不信咱们就看看。我们可以用这个包画出个性化词云图。

这个包里面包含了两个数据集,demoFreqC和demoFreq,前者是一些中文数据,后者是一些英文数据。这两个数据都包含了两个变量,一个是文本,另一个是文本的数量。大家可以使用str()函数来查看数据的详细信息。这个表主要有两个函数letterCloud和wordcloud2。

转载请注明出处51数据库 » rwordcloud

丶浅陌丶

丶浅陌丶